Скандал: демонстрация нейросети Google Gemini оказалась фейком

Не очень понятно, зачем нужно было так делать.

Вчера Google представила Gemini — новую языковую модель, которая сразу же стала частью ИИ чат-бота Bard.

Тогда же был представлен очень впечатляющий ролик, демонстрирующий возможности Gemini.

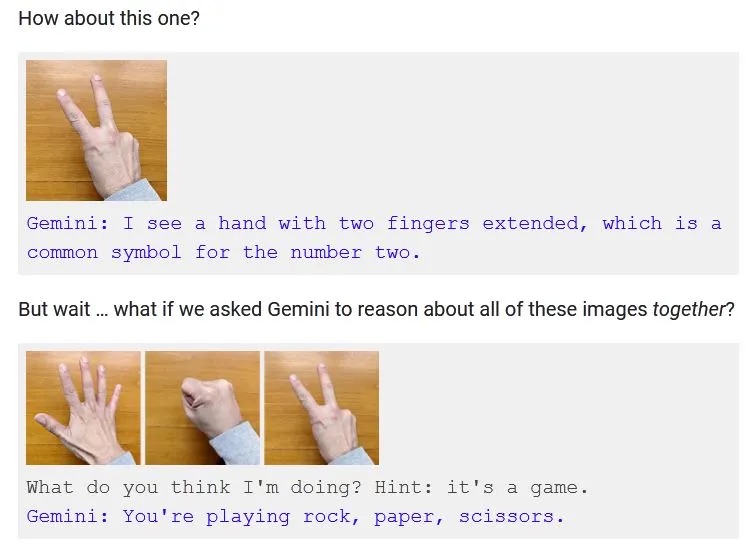

Например, ИИ мог распознать движения рукой и сказать, что человек играет в «Камень, ножницы, бумагу». И это означает, что нейросеть смогла уловить абстрактную идею и декодировать её.

Нет. Оказалось, что Gemini распознаёт «Камень, ножницы, бумагу» иначе: ей нужно показать три фотографии с ладонью, сжатым кулаком и двумя пальцами. Взаимодействие с нейросетью происходило не голосом, а прописанным текстом с прямой подсказкой «Это игра». И уже на основе этих данных, являющихся намекаемым воздействием, Gemini угадывала игру. И это очень сильно отличается от декодирования абстракции.

И таких примеров в ролике множество. Например, с порядком объектов Солнечной системы, игрой в напёрстки, в которой под один из трёх стаканов кладут скомканный клочок бумаги. Для работы всех этих примеров Google потребовались иные взаимодействия, которые говорят, что Gemini обучена на этих образах, а другие она вряд ли распознает.

Позже вице-президент по исследованиям Google DeepMind Ориол Виньялс добавил, что ролик является демонстрацией того, что «видео иллюстрирует, как может выглядеть мультимодальный пользовательский опыт, созданный с помощью Gemini». А сделано это, чтобы вдохновить разработчиков. Но почему это нельзя было сказать сразу?